Fala, pessoal! Bora entender o que são as redes neurais artificias! Vou tentar ser o mais didático possível para explicar os conceitos e a lógica. Depois, veremos alguns e exemplos e aplicações dessa técnica no nosso dia-a-dia. Compreender a “mágica” das redes neurais nos ajuda muito a entender um pouco melhor como a inteligência artificial funciona.

Sumário

- O que é uma Rede Neural Artificial?

- Como Funciona uma Rede Neural?

- Camadas Escondidas: O Coração da Rede Neural

- Aprendizado: Como Ensinar uma Rede Neural?

- Matemática por Trás das Redes Neurais

- Exemplos de Redes Neurais Artificiais

- Redes Neurais Profundas: Quando as Coisas Ficam Sérias

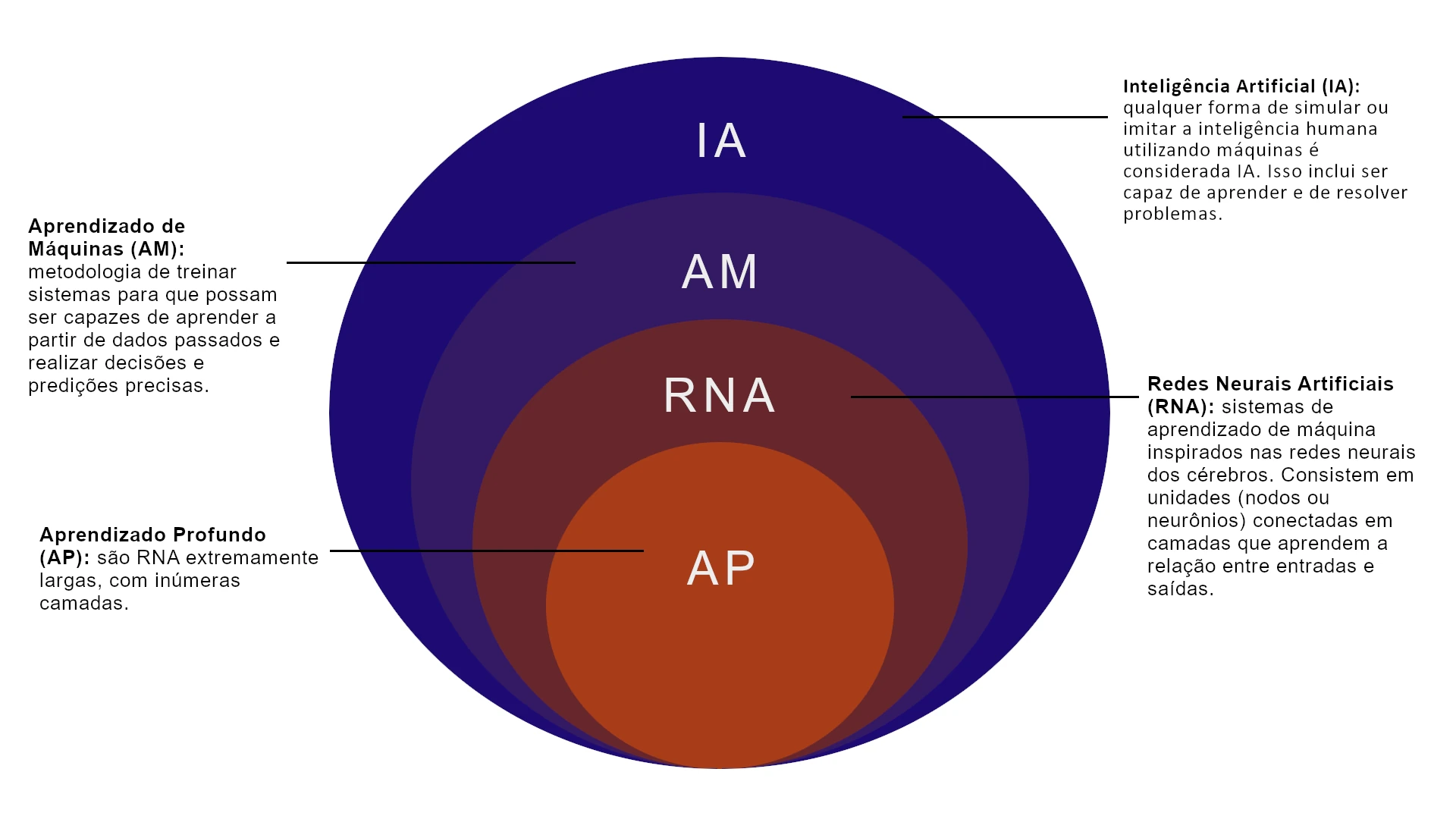

O que é uma Rede Neural Artificial?

O termo rede neural vem da inspiração do modelo com o funcionamento dos nossos cérebros, onde temos neurônios que propagam impulsos elétricos um para o outro, transmitindo rapidamente informações. Esse trabalho conjunto envolvendo milhões de neurônios é que nos permite pensar, mover, sentir e até mesmo ler este texto. Uma rede neural artificial (RNA) é uma tentativa de imitar o cérebro humano, dentro de um computador.

Os “neurônios” em uma RNA são chamados de nodos. Os nodos nada mais são do que funções. E o que é uma função? Um função é como se fosse uma máquina: você coloca coisas dentro dela (“inputs” ou “features” ou entradas), ela realiza algumas operações e entrega um produto (“output” ou resultado). Em uma rede neural artificial, teremos inúmeros nodos, ou seja, inúmeras funções que se retro alimentam até chegar em um resultado final.

Como Funciona uma Rede Neural?

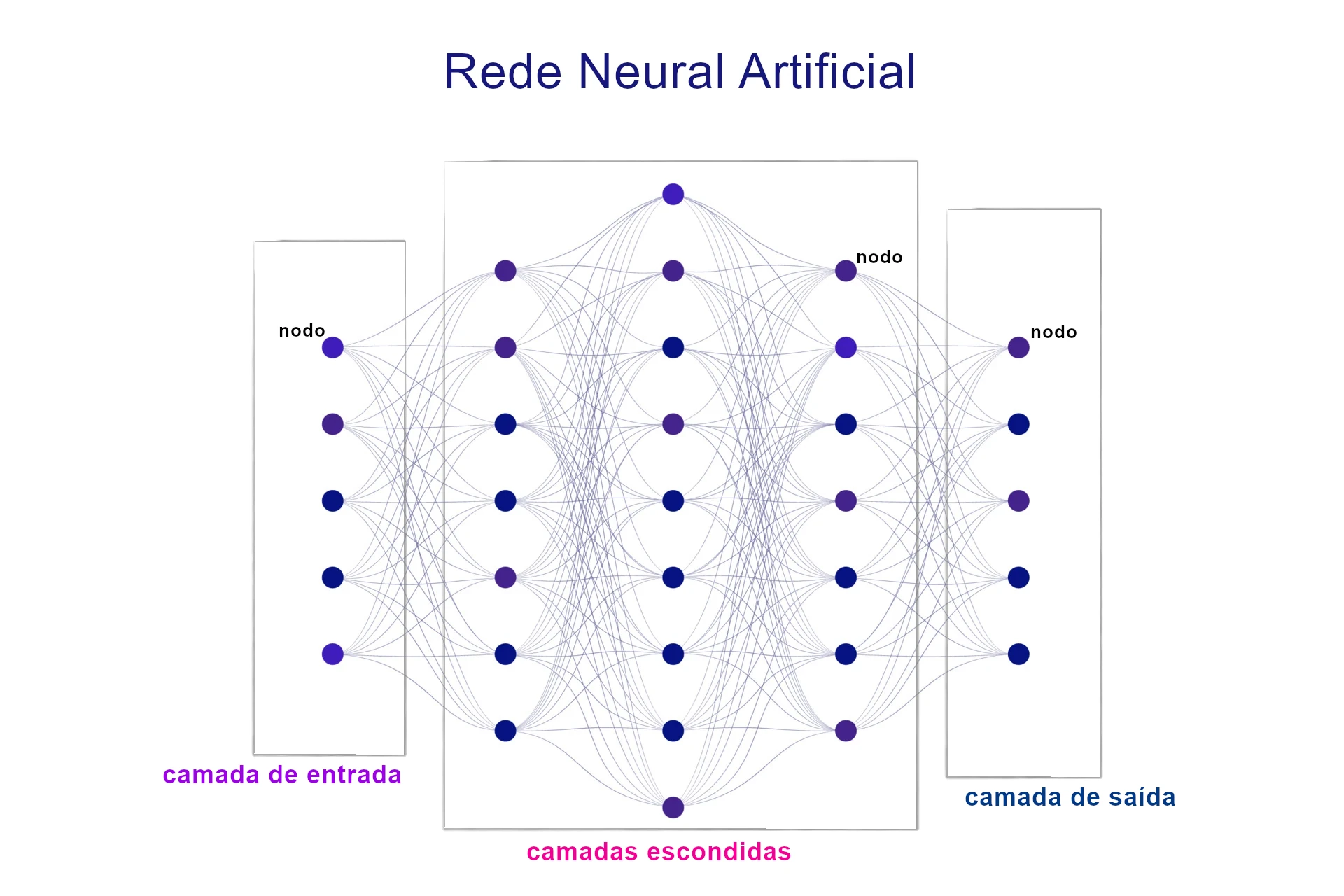

Os nodos (“neurônios artificiais”) de uma rede neural são organizados em camadas: camada de entrada, camadas escondidas (ou ocultas) e camada de saída.

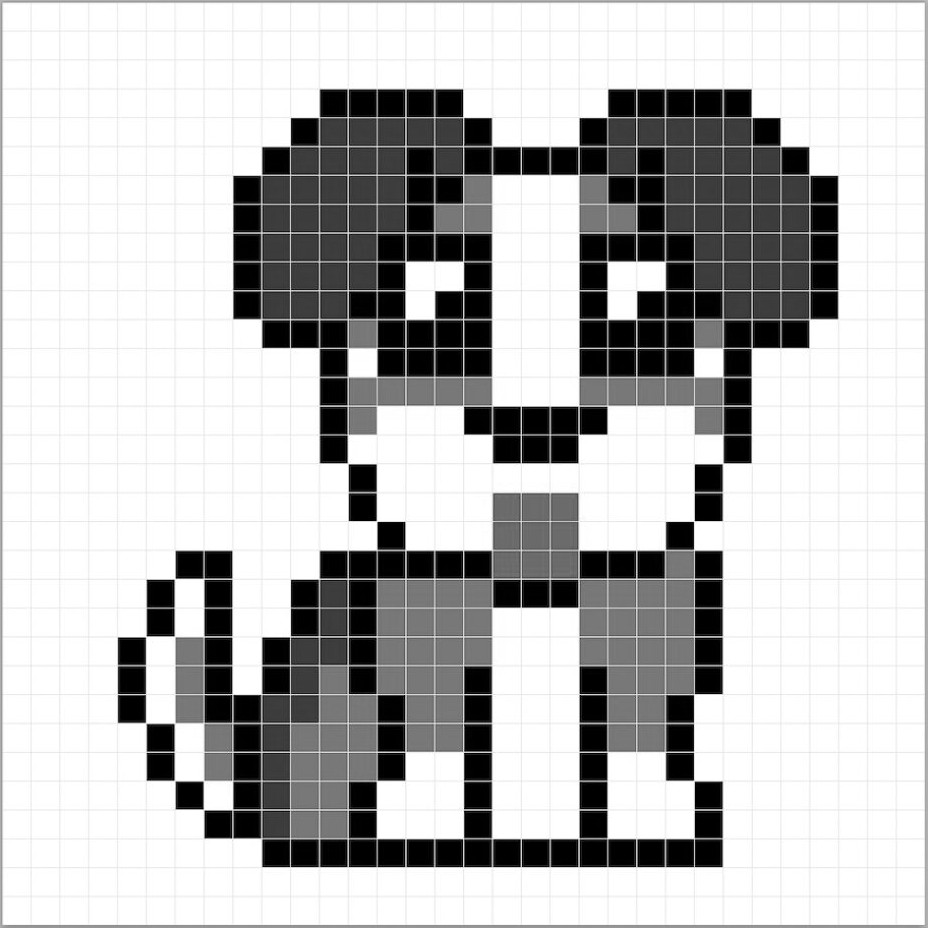

Vamos considerar um caso bem simples para fins didáticos: nosso modelo pretende identificar se a imagem abaixo é um gato ou um cachorro.

1. Camada de Entrada: A rede neural começa recebendo a imagem. A imagine é dividida em milhões de pequenos quadradinhos (pixels), cada um com sua correspondente cor. A camada de entrada atribui um valor para esses pixels, os quais serão, cada um, um nodo de na camada de entrada.

Para simplificar, visualizamos abaixo apenas quatro pixels, constituindo 4 nodos de entrada. Na realidade, considerando que a imagem tem 32×32 pixels, teríamos 1.024 nodos de entrada.

2. Camadas Escondidas: As camadas escondidas são onde a mágica realmente acontece. Cada neurônio em uma camada escondida se liga a neurônios da camada anterior, fazendo cálculos complexos para reconhecer padrões (por exemplo, o formato de uma orelha de um cachorro).

3. Camada de Saída: Finalmente, a camada de saída diz o que a rede neural acha que a imagem é: um gato ou um cachorro. Cada neurônio na camada de saída representa uma resposta possível, e o neurônio com a maior ativação ganha!

Camadas Escondidas: O Coração da Rede Neural

Agora, vamos mergulhar mais fundo nas camadas escondidas. Essas camadas são chamadas assim porque estão “escondidas” entre a camada de entrada e a camada de saída. Elas são onde a maior parte do trabalho acontece. Vamos detalhar o que cada camada escondida faz:

- Detecção de Padrões Simples: As primeiras camadas escondidas detectam padrões básicos, como linhas e bordas. Pense nisso como o que você veria se olhasse para uma imagem com uma lupa bem poderosa. Essas camadas identificam pequenos detalhes que compõem a imagem.

- Combinação de Padrões Simples: As camadas seguintes combinam esses padrões simples para reconhecer formas mais complexas. Por exemplo, uma linha curva pode ser parte de uma orelha de gato ou de um focinho de cachorro. Essas camadas começam a juntar as peças do quebra-cabeça.

- Reconhecimento de Objetos Complexos: À medida que avançamos nas camadas escondidas, elas combinam formas e padrões para reconhecer objetos inteiros. Neste ponto, a rede neural pode identificar um olho, uma orelha e outras partes de um gato ou cachorro.

- Abstração de Alto Nível: Nas camadas mais profundas, a rede neural começa a formar conceitos abstratos. Não está apenas vendo um conjunto de linhas e formas, mas reconhecendo o que esses padrões significam. Por exemplo, pode entender que uma determinada combinação de formas representa um gato ou um cachorro.

Essas camadas escondidas são como pequenos detetives que analisam pistas (padrões) para resolver um mistério (reconhecer a imagem). Cada neurônio faz um pedacinho do trabalho, e todos juntos chegam à resposta final.

Aprendizado: Como Ensinar uma Rede Neural?

Treinar uma rede neural é como ensinar um cachorro a sentar. Você mostra ao cachorro o que fazer, dá um petisco quando ele acerta, e repete até ele aprender. Na rede neural, fazemos algo parecido, só que com números:

- Dados de Treinamento: Primeiro, precisamos de muitos exemplos (fotos de gatos e cachorros com os rótulos corretos).

- Propagação para Frente (Forward Propagation): A rede neural faz uma previsão para cada exemplo. No início, as previsões são ruins porque a rede ainda não aprendeu nada.

- Erro: Calculamos o erro, que é a diferença entre a previsão da rede e a resposta correta.

- Propagação para Trás (Backward Propagation): Ajustamos os neurônios da rede para diminuir o erro. É como dizer ao cachorro que ele fez errado e mostrar como fazer certo.

- Repetição: Repetimos esses passos milhares ou milhões de vezes até a rede neural fazer boas previsões.

Matemática por Trás das Redes Neurais

Agora, vamos dar uma espiadinha na matemática básica por trás das redes neurais. Não se assuste! Vou explicar de um jeito simples.

- Pesos e Biases: Cada conexão entre neurônios tem um peso, que é um número que diz o quão forte essa conexão é. Cada neurônio também tem um bias, que é um número que ajuda a ajustar a ativação do neurônio.

- Função de Ativação: Depois que um neurônio recebe os sinais de todos os neurônios conectados a ele, ele soma esses sinais (multiplicados pelos pesos) e adiciona o bias. Em seguida, ele passa essa soma por uma função de ativação, que decide se o neurônio “dispara” ou não. Algumas funções de ativação comuns são a ReLU (Rectified Linear Unit) e a sigmoid.

- Propagação para Frente: A propagação para frente é o processo de enviar a entrada pela rede, neurônio por neurônio, camada por camada, até chegar à saída.

- Função de Perda: A função de perda mede o quão errada está a previsão da rede. Por exemplo, se a rede diz que uma imagem de gato é um cachorro, a função de perda calcula um valor alto (grande erro). Se a rede acerta, a função de perda calcula um valor baixo (pequeno erro).

- Propagação para Trás e Atualização de Pesos: A propagação para trás usa a derivada da função de perda em relação a cada peso para descobrir como ajustar os pesos e diminuir o erro. Este processo é chamado de “gradiente descendente”.

Exemplos de Redes Neurais Artificiais

Para deixar tudo mais claro, vamos ver alguns exemplos de redes neurais no mundo real:

- Assistentes Virtuais (como Siri e Alexa): Quando você faz uma pergunta à Siri ou à Alexa, elas usam redes neurais para entender sua voz e encontrar a resposta correta.

- Tradução Automática: Ferramentas como o Google Tradutor usam redes neurais para traduzir textos de uma língua para outra. Elas aprendem com milhões de exemplos de traduções humanas.

- Reconhecimento de Imagens: Aplicativos que identificam plantas ou raças de cães a partir de fotos usam redes neurais para analisar as imagens e fazer a correspondência.

- Jogos de Vídeo: Alguns jogos usam redes neurais para criar personagens que aprendem e se adaptam às suas ações, tornando o jogo mais desafiador.

Redes Neurais Profundas: Quando as Coisas Ficam Sérias

Quando adicionamos muitas camadas escondidas, chamamos isso de redes neurais profundas (ou “deep learning”). Elas são ótimas para resolver problemas muito complexos, como:

- Condução Autônoma: Carros autônomos usam redes neurais profundas para entender o ambiente ao seu redor, reconhecer pedestres, sinais de trânsito e outros carros.

- Diagnóstico Médico: Redes neurais profundas ajudam a detectar doenças em exames de imagem, como câncer em mamografias.

- Criação de Arte e Música: Existem redes neurais que podem criar pinturas, compor música e até escrever poesias!

Comments are closed